在信息爆炸的時代,大數據已成為驅動社會進步與商業創新的關鍵要素。其核心挑戰不僅在于數據的海量性,更在于如何高效、可靠地存儲這些數據,并在此基礎上構建強大的數據處理與存儲支持服務體系。本文將從存儲架構、數據處理流程及支持服務三個維度,系統探討大數據技術如何應對這些挑戰。

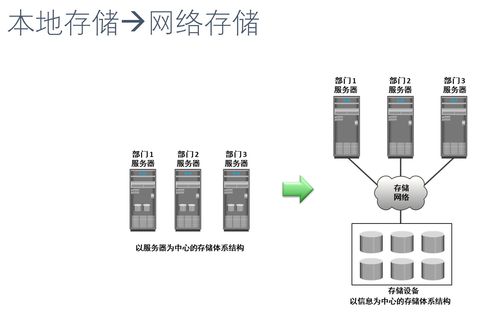

一、 大數據存儲:從集中到分布式的范式轉變

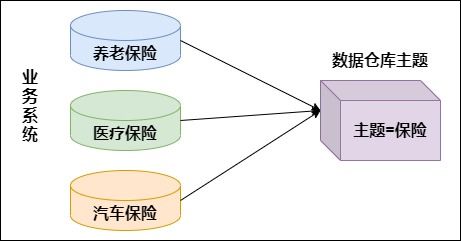

傳統的關系型數據庫在面對PB級甚至EB級非結構化、半結構化數據時,在擴展性、成本和處理速度上捉襟見肘。因此,大數據存儲的基石轉向了分布式文件系統與NoSQL數據庫。

- 分布式文件系統:以Hadoop Distributed File System(HDFS)為代表,它將大文件分割成塊(Block),分散存儲在廉價的商用服務器集群中。這種設計不僅提供了近乎無限的橫向擴展能力,還通過多副本機制確保了數據的高容錯性。類似地,谷歌的GFS、阿里的盤古等也是這一理念的實踐。

- NoSQL數據庫:針對不同數據模型和訪問模式,衍生出多種類型。鍵值存儲(如Redis、DynamoDB)適合高速緩存與會話存儲;列族存儲(如HBase、Cassandra)擅長處理海量結構化與半結構化數據的隨機讀寫;文檔數據庫(如MongoDB、Couchbase)以靈活的JSON/BSON格式存儲復雜對象;圖數據庫(如Neo4j)則專注于關系網絡的存儲與查詢。這些數據庫通常采用分布式架構,犧牲了嚴格的事務一致性(遵循BASE原則),以換取更高的可用性與分區容錯性。

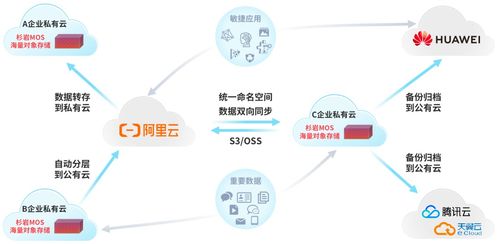

- 新興存儲范式:對象存儲(如AWS S3、阿里云OSS)憑借其極佳的擴展性、耐用性和低成本,已成為海量非活躍數據(如日志、備份、多媒體)的存儲標準。基于內存的分布式存儲(如Apache Ignite)和時序數據庫(如InfluxDB)也在特定場景下發揮著重要作用。

二、 數據處理:存儲之上的計算引擎與流程

存儲是基礎,而數據的價值需要通過處理來釋放。大數據處理形成了批處理、流處理與交互式查詢并存的生態。

- 批處理:針對歷史海量數據的離線計算。以Hadoop MapReduce為鼻祖,其將計算任務分發到數據所在的存儲節點,遵循“移動計算而非數據”的原則,減少了網絡傳輸開銷。隨后出現的Apache Spark,憑借其內存計算和DAG執行引擎,將批處理性能提升了一個數量級,成為當前的主流選擇。

- 流處理:針對無界數據流的實時計算。從早期的Apache Storm,到兼具高吞吐與容錯的Apache Flink,再到與Kafka深度集成的Kafka Streams,流處理技術使得實時監控、實時風控、實時推薦等應用成為可能。流處理與批處理的邊界正在模糊,Lambda架構和更新的Kappa架構旨在統一處理模型。

- 交互式查詢:為了實現對海量數據的快速即席查詢,出現了如Apache Hive(將SQL轉化為MapReduce/Spark任務)、Presto、Impala等SQL-on-Hadoop引擎,以及云數據倉庫如Snowflake、BigQuery,它們提供了近乎實時的復雜查詢能力。

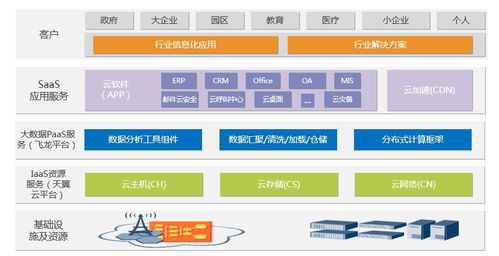

三、 數據處理與存儲支持服務:平臺化與云化賦能

為使大數據技術更易用、更高效,一系列支持服務應運而生,它們將復雜的底層技術封裝成可管理、可編排的服務。

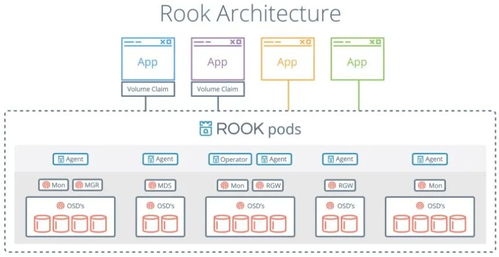

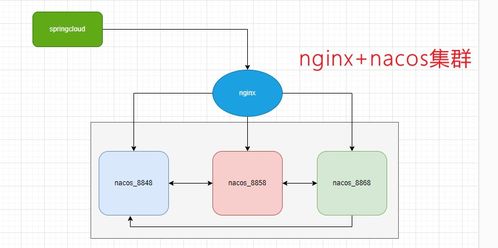

- 集群管理與調度服務:如Apache YARN和Kubernetes。YARN作為Hadoop2.0的核心,將資源管理與作業調度分離,允許多種計算框架(MapReduce, Spark, Flink)共享集群資源。Kubernetes則以其強大的容器編排能力,成為部署和管理云原生大數據組件的首選,實現了更靈活的資源隔離與彈性伸縮。

- 數據編排與生命周期管理:Apache Airflow、DolphinScheduler等工作流調度工具,用于編排復雜的數據處理管道(ETL)。數據湖管理框架如Delta Lake、Apache Iceberg和Hudi,在分布式存儲之上提供了ACID事務、版本控制、模式演進等能力,使得數據湖更加可靠和易于管理。數據目錄服務(如Apache Atlas)則實現了數據的元數據管理和血緣追蹤,保障數據治理。

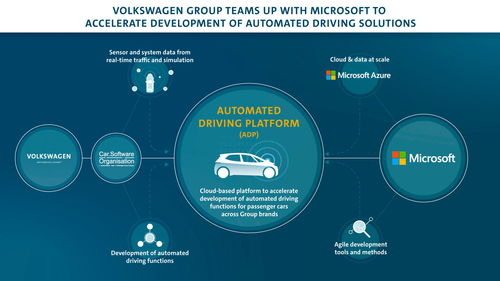

- 云存儲與計算服務:公有云廠商(如AWS, Azure, 阿里云)提供了全托管的大數據服務。例如,對象存儲(S3/OSS)作為幾乎無限容量的底層存儲;EMR、Databricks等托管集群服務簡化了Spark/Hadoop的運維;云原生數據倉庫(Redshift、BigQuery、AnalyticDB)則開箱即用,用戶無需關心底層基礎設施。這種“存儲與計算分離”的架構,結合按需付費的模式,極大地降低了企業使用大數據技術的門檻和總擁有成本(TCO)。

與展望

大數據存儲已從單一的數據庫解決方案,演進為一個多層次、多模態的分布式生態系統。數據處理引擎正朝著流批一體、湖倉融合的方向發展,以提供更統一和高效的數據處理體驗。而圍繞數據處理與存儲的支持服務,特別是云服務的普及,正使得大數據能力從技術專家的手中, democratize(民主化)到更廣泛的業務與數據分析人員。隨著人工智能與機器學習工作負載的深度集成,以及對數據隱私、安全與合規性要求的不斷提高,大數據存儲與處理體系將持續演進,其核心將始終圍繞如何更經濟、更智能、更安全地存儲數據,并從中提取最大價值。